Önsöz: Bu yazıda robotik exoskeleton teknolojisinde gelinen durum, kullanım alanları ve benzeri teknik bilgilerden ziyade bu alanda 20 senedir çalışan bir araştırmacının ilk ağızdan kişisel gözlemleri aktarılmaktadır. Üretilen bir exoskeleton prototipinin daha dünyaya açılmadan önceki ilk hali, onunla ilk etkileşime geçen insan (araştırmacı) üzerinde yarattığı etkiler ve bu tetikleme üzerinden araştırmacının kendine çizdiği yol konu edilmiştir.

Robotlar tekinsiz varlıklar. Bir robot prototipi üzerinde yeni tasarladığım bir kontrolcü yazılımını test ettiğim bir 2006 yaz akşamından beri geçen yaklaşık 20 seneden beri bu duygu benliğime işlemiş durumda. Tüm yazılımını satır satır kontrol de etsem, tüm donanımını en baştan ayrıntılı gözden geçirsem dahi hiçbir deneyde bilinmezlik faktörü sıfırlanamaz. Prototiplerin beklenmedik davranışları uygulamalı çalışan tüm mühendislerce bilinen bir durum. Ancak robotların fiziksel yapısına içkin hareket ve güç kapasiteleri ve kontrol dışı anlarda tahayyül edilemeyecek şekildeki hareketleri onları gözümde tekinsiz kılar. Kimi zaman bir robot uzvu son hızla aniden hareket edip yüzümü sıyırmaktadır, kimi zaman iletişim ağı kopan bir quadruped robot üzerime üzerime gelmektedir. Acil durum butonu ise yalnızca acil olmayan anlarda çalışır. Prototip robotlarla uzaktan çalışamazsınız. Eğer bir robot tam da beklediğim gibi çalışırsa yanına gidip onu bozmaya çalışırım, iterim kakarım. Sınırlarını anlamaya çalışırım. Robotlarla aramdaki ilişkisellik kontrol üzerinden yürür ve tekinsizdir.

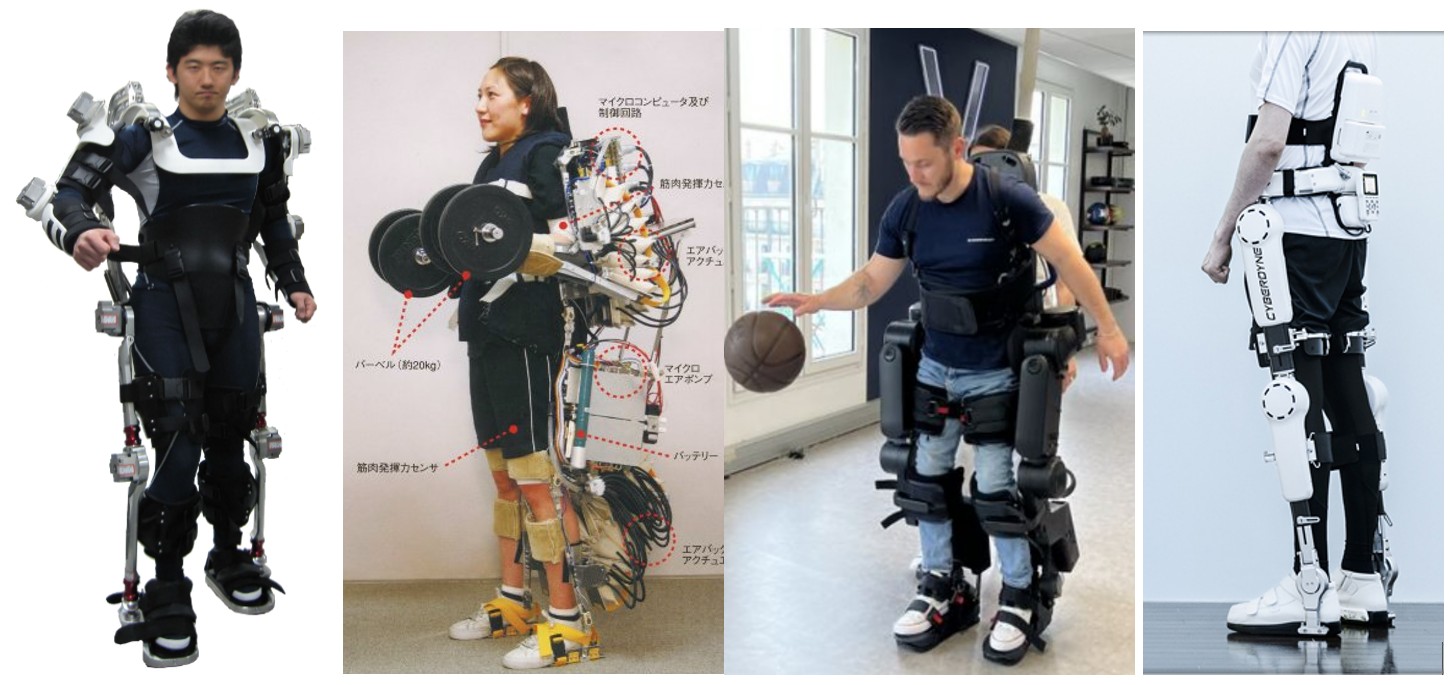

İnsansı robotlar üzerinde 5 yıl kadar kuramsal ve uygulamalı olarak çalıştıktan bir süre sonra 2011 yılında Toyota Teknoloji Enstitüsü’nden iş teklifi aldım. Kurum, giyilebilir bir robot türü olan exoskeleton teknolojisine yatırım yapmayı planlamaktaydı ve benden beklenen insansı robotlar için geliştirdiğim teknolojinin exoskeletonlara aktarılmasıydı. Bu noktada öncelikle robotik exoskeletonun bir tanımını yapalım: Robotik exoskeleton giyilebilir bir robotik platform olup kullanıcının belli bir eklem, eklem grubu veya tüm vücuduna güç desteği sağlayabilen bir sistemdir. Şekil 1’de çeşitli türlerini gözlemleyebilirsiniz. Herhangi bir güç artırımı yapmayan pasif varyantları da var olmakla beraber aktif güç desteği sağlayabilen robotik exoskeletonlar özellikle rehabilitasyon ve güç desteği gerektiren endüstriyel uygulamalar ile varsayımsal olarak askeri uygulamalarda kullanılabilmektedir.

Toyota Teknoloji Enstitüsü’nde geliştirdiğimiz exoskeleton prototipi olan TTI-Exo Şekil 1’de en solda görülebilir. Mekanik tasarım ve montaj evreleri biter bitmez hiçbir yenilikçi kontrol tasarımı yapmadan robotu üzerimde denedim. İki net gözlemim oldu: i) içinde hareket etmek çok zordu; önemli ölçüde efor sarf edilse dahi hareket kabiliyetim çok sınırlıydı, ii) dışardan robota bir komut verildiğinde ise benliğimin dışında hareket etmek beni çok rahatsız etti.

Yakınındayken dahi tekinsiz hissettiğim robotların içine girmek (veya bu araştırma alanına dahil olmak) ise Minotaur’un labirentine girmekle eşdeğerdi: ya içinden çıkılamayacak ya da çıkılsa bile giren kişi olmayarak çıkılacaktı.

Teknik olarak bana rahatsızlık veren ilk hissiyat literatürde transparency (ya da zero impedance) olarak bilinen problemdir. Robot eyleyicileri yüksek tork kapasitesine ulaşmak için yüksek dönüşüm oranlı dişliler içerirler. Bu da geri sürülemezlik (İng. non-backdrivability), atalet yansıması, sürtünme gibi problemleri meydana getirir. Çözümü için eyleyici ve eklem uzayında çok detaylı bir matematiksel modelleme yapmak, tüm sürtünme rejimlerini karakterize etmek gerekti. Bunu sağladığımızda ise eyleyiciler ideal bir kuvvet kaynağı gibi davranmaya başladı. Bu sayede tüm iç bozucu kuvvetleri elimine oldu ve robotun kendi ağırlığından ötürü oluşan yükler model temelli karşılandı. Sadece istenen ölçüde istenen zamanlamada kuvvet sağlaması başarıldı.

Gerçekleştirdiğim ilk exoskeleton kontrolcü yazılımını bir süre içine girmeden test ettikten sonra ilk denek olarak kendimi seçtim. İngilizce’deki “taste your own medicine” deyimi aslen bu durumu karşılamasa da deney öncesi beynimde yankılandığını hatırlıyorum. Öncelikle transparency modunu denedim. Robot herhangi bir destek vermiyordu ama hiçbir dirençle karşılaşmıyordum. Üstümde bir kabuğun varlığı vardı ama ağırlığı yoktu. Mühendis olmayan yanım bu yeni duyguyla tanışırken mühendis yanım “ok! sensorless torque control çalışıyor” diye düşünüyordu. Sonrasında ise power assist moduna geçtim ve elime 10 kg’lık bir dumbbell aldım. Prototip tüm vücut boyunca destek sağlıyordu. Dumbbell’i taşırken daha önce hiç tecrübe etmediğim bir fiziksel etkileşim içindeydim. Elimde bir ağırlık vardı ve yorulmadan saatlerce tutabilirdim. Varlığı vardı ama ağırlığı yoktu. Hissi vardı ama yerçekimi o cisim için yok olmuştu. Ağırlığı biraz oynattım, bir süre elimde tuttum, ve sıkıldım. Yazılım ve prototip düzgün çalışıyordu. Bias oluşturmayacak farklı subjelerle deneylere ve ileri safhalara geçildi. Ben ise bir daha o robotu kullanma ihtiyacı hissetmedim.

İki yıl boyunca süren bu çalışmalardan sonra ise Kyoto’daki ATR Hesaplamalı Sinirbilim Laboratuvarı’na katıldım. Katıldığım grubun adı Beyin-Robot Arayüzü idi ve adından da anlaşılacağı üzere direkt olarak insan beyni ile robot arasında bir link oluşturmak isteniyordu. Bu tip arayüzler geçişsiz (İng. noninvasive) veya geçişli (İng. invasive) olabilir. Kabaca tarif etmek gerekirse geçişsiz arayüzde ameliyatla beyninizdeki belli bölgelere elektrodlar yerleştirilir ve bu geçişli arayüzler sadece ABD’de legaldir. Dolayısıyla bizim grubumuz geçişsiz bir yöntem izledi. Yürüme hareketinin fazlarının insan kafatasına yerleştirilen EEG (İng. Electroencephalography) problarıyla klaslandırılmasına çalışıldı. Bu çalışmanın paralelinde ise yapay kaslarla hareket ettirilebilen XoR adında bir exoskeleton robot üretildi; bkz Şekil 2.

Nüfusu hızla yaşlanan Japonya’da exoskeletonların rehabilitasyon amaçlı kullanımı başlıca hedeflenen konulardan biri. ATR’da ürettiğimiz exoskeletonu bir rehabilitasyon kliniğine götürdük ve terapistlerle beraber robot üzerinde çalıştık. Klinikte yapılan rehabilitasyon çalışmalarını gözlemlediğimde robotun kullanıcılara destek sağlayabildiğini ancak insan-robot sisteminin dengesinin yeterince stabil olmadığını düşündüm. Exoskeleton hem içerde kullanıcı kaynaklı, hem de dış kaynaklı bozucu etkilere maruz kalabiliyordu ve kullanımı %100 güvenli değildi.

Bir exoskeleton her tip durumda öz dengesini koruyabilmeli diye düşünerek öncelikle insan dengesinin biyomekaniğine çalıştım. Başlangıçtaki düşüncemin (ve insansı robotlarda uyguladığımızın) aksine insanlarda denge kas gücünden ziyade merkezi sinir sisteminin kasların mekanik empedansını regüle etmesiyle sağlanıyordu. Bu bilgi ışığında yapay kaslarla hareket kabiliyeti sağlanan XoR üzerinde biyo-ilhamlı bir kontrol mekanizmasını geliştirdim. XoR, içerisinde cansız ve eklemli manken varken her türlü darbeye maruz bırakıldığında bile yapay kaslarının empedansını gerçek zamanlı regüle ederek dengede kalmayı başardı. Hacıyatmaz gibiydi. ATR’ ın Beyin-Robot Arayüzü grubunca üretilen XoR, literatürdeki ilk özdengelemeli exoskeleton ünvanına erişti (Ugurlu vd., 2016) ve beyin-robot arayüzü ile kontrol edildi (Noda vd., 2012).

2015 yılında Özyeğin Üniversitesi’ne katıldığımda da Türkiye’yi exoskeleton teknolojisi konusunda lider ülkelerden biri haline getirmeyi amaçladım. ATR’da geliştirdiğim dış iskelet robot sadece sagital (ön-arka) eksende özdengeleme sağlayabiliyordu. Kuruma katılmamla beraber TÜBİTAK 1001 programına yaptığım başvuru kabul oldu. Bu proje kapsamında kuvvet kontrollü özel eyleyicilere sahip, her eksende kendi kendini dengeleyebilen Co-Ex (Compliant Exoskeleton for human-robot Co-Existence; bkz. Şekil 3) adlı exoskeletonu geliştirdik. 2020’de tüm fonksiyonel testlerini tamamladık, bu testler literatürde yerini aldı ve sistem de ayrıca patent koruması altına alındı (Coruk vd., 2020 Yıldırım vd., 2026, Soliman vd., 2024). Laboratuvarımdaki exoskeleton çalışmaları iş arkadaşlarımla ortak bir şekilde farklı evrim çizgilerinde devam ettiriliyor.

20 yıllık bu akışı bir kenara bırakıp ilk ürettiğim exoskeletonla aramdaki tanışma anına geri dönelim. Bütün bu projeler, patentler, yazılan kodlar, tasarlanan mekanizmalar, tartışmalar, sentezlerin öncesindeki an. Prototipin -her prototipte olduğu gibi- performans sınırları vardı, bilim-kurgu-vari bir durum yoktu, alandaki meslektaşlarımın anlayabileceği bir teknolojiydi. Ancak avucumda hissettiğim o yapay kuvvette bir tekinsizlik vardı. Ara ara o anı düşünürüm.

O an asıl tekinsiz olan şey kuvvetin büyüklüğü değildi. Kuvvetin kaynağıydı. Tüm sistemin ayrıntılı matematik modelini biliyordum, kontrolcü yazılımındaki her satır bana aitti. Ama avcumdaki yük hafiflediğinde soru teknik olmaktan çıktı: Bu hareketin faili kimdi? O yükü ben mi kaldırıyordum, yoksa benimle birlikte çalışan bir sistem mi? Bir uzvu “benim” yapan şey yalnızca sinirsel komut mudur, yoksa o uzvun gerçekleştirdiği işlev midir? Eğer işlev belirleyiciyse, dışarıdan eklenen bir kuvvet ne zaman bana ait olur?

Aristoteles’in madde-form kuramında ruh, doğal ve potansiyel olarak bedenin ilk energia’sıdır (energia: kabaca potansiyeli fiili eyleme çevirme gücü). “Eğer göz başlı başına bir canlı olsaydı, görmek onun ruhu olurdu” der. Bu bağlamda sinir sistemine entegre, sürekli geri beslemeli, beden şemasına dahil bir exoskeleton üretebildiğimizi düşleyelim. Farklı bir gezegende, yüksek yerçekimi etkisi altında günlük işlevlerimizi söz konusu exoskeletonsuz yapamadığımızı, sürekli kullanımdan ötürü bu yapay sistemin kortikal haritalamada artık doğal bir uzvumuz gibi algılandığını tahayyül edelim. Her yeni jenerasyonla birlikte exoskeleton teknolojisinin geliştiğini, yeni doğan bireyler arasından exoskeleton sistemine uyum (CNS adaptasyonu) sağlayabilenlerin doğal seçilim sonucu daha çok gen aktarımında bulunabildiklerini ve bu tip bir eş-evrim süreci oluştuğunu hayal edelim. Bu senaryodaki insanla biz aynı insan olur muyuz?

Ve sinir sistemine entegre olan bu exoskeletonun bir gün insanın karar alma mekanizmasına ortak olduğunu düşünelim. Yeni bir rasyonel bütünlük oluşmaz mı? Akıl yürütme, amaç belirleme, ve hatta normatif değerlendirme gibi düşünsel işlerin ortak yürüdüğünü varsayalım. Bu durumdaki insan-robot melezi bizimle aynı tür olur mu?

O gün avcumda hissettiğim yapay kuvvet, herhangi bir form sahibi olmaksızın halen aklımın gölge bir köşesinde duruyor.

I want more life, father.

Roy Batty, 2019 (1982)

Referanslar:

Coruk, S., Soliman, A. F., Dalgic, O., Yildirim, M. C., and Ugurlu, B. (2020). Towards Crutch-Free 3-D Walking Support with the Lower Body Exoskeleton Co-Ex: Preliminary Experiments, in Proc. of the International Symposium on Wearable Robotics (WeRob).

Ishii vd. (2005). Stand-alone wearable power assist suit–development and availability. Journal of Robotics and Mechatronics, 17(5).

Noda vd. (2012). Brain-controlled exoskeleton robot for BMI rehabilitation. The 12th IEEE-RAS International Conference on Humanoid Robots.

Soliman, Ugurlu vd. (2024). Design, Development, and Control for the Self- Stabilizing Bipedal Exoskeleton Prototype Co-Ex, IEEE/ASME Transactions on Mechatronics, 30(1).

Tsukuhara vd. (2010). Sit-to-stand and stand-to-sit transfer support for complete paraplegic patients with robot suit HAL. Advanced Robotics, 24(11).

Ugurlu vd. (2016). Variable Ankle Stiffness Improves Balance Control: Experiments on a Bipedal Exoskeleton. IEEE/ASME Transactions on Mechatronics, 21(1).

Ugurlu vd. (2020). Active Compliance Control Reduces Upper Body Effort in Exoskeleton-Supported Walking. IEEE Transactions on Human-Machine Systems, 50(2).

Vigne vd. (2020). Improving Low-Level Control of the Exoskeleton Atalante in Single Support by Compensating Joint Flexibility. IEEE/RSJ IROS 2020.

Yildirim, M. C., Ugurlu, B., Sendur, P., Emre, S., Derman, M., & Coruk, S. (2026). Wearable lower extremity exoskeleton (U.S. Patent No. 12,521,298). U.S. Patent and Trademark Office. https://patents.google.com/patent/US12521298B2/en

Reinforcement learning is a powerful tool for teaching robots new skills, but it often comes with a serious drawback: training takes a very long time. Robots need to try thousands of actions, make many mistakes, and slowly improve through trial and error. In real robotic systems, this process can be expensive, slow, and sometimes unsafe.

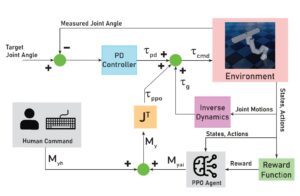

In this work, we explored a simple idea: what if humans help the robot while it is learning? Instead of letting the robot learn completely on its own, we allow a human to guide the robot during training. This approach is known as human-in-the-loop learning, and it can significantly speed up skill acquisition.

We tested this idea on a ball-balancing task using a simulated 7-degree-of-freedom robotic arm. The robot’s goal was to keep a ball balanced at the center of a tray attached to its end effector, even when disturbances were applied. This task is challenging because it requires smooth control, quick reactions, and good use of the robot’s redundancy.

During training, the robot learned using reinforcement learning, while a human provided small corrective actions through simple keyboard inputs. As training progressed and the robot became more competent, the influence of the human was gradually reduced. Eventually, the robot was able to perform the task autonomously.

The results were clear. With human guidance, the robot learned the task much faster and with far fewer training episodes compared to fully autonomous learning. Training time was reduced from hours to minutes, and the learned behavior was more stable and robust. The robot also handled external disturbances better and showed smoother motion during testing.

An interesting observation was that human behavior matters. Different participants guided the robot in slightly different ways, and this affected how quickly and how well the robot learned. Even so, almost all human-guided training sessions resulted in successful skill acquisition, showing that the approach is robust to individual differences.

Overall, this study shows that humans do not need to fully control a robot to make learning effective. Even small and simple guidance can help reinforcement learning algorithms explore better actions and avoid unnecessary failures. Human-in-the-loop training offers a practical way to make robot learning faster, safer, and more reliable, especially for complex control tasks.

*This blog post is based on the paper *“Human-in-the-Loop Training Leads to Faster Skill Acquisition and Adaptation in Reinforcement Learning-based Robot Control”

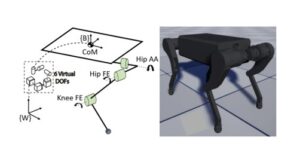

Quadruped robots are good at walking, but things become much harder when the robot needs to jump or jog in place. These motions require the robot to carefully control its balance while its body moves up and down. Many existing approaches focus on keeping the robot’s center of mass at a constant height, because that makes the math easier. However, jumping and jogging are exactly the motions where the center of mass must change vertically.

Quadruped robots are good at walking, but things become much harder when the robot needs to jump or jog in place. These motions require the robot to carefully control its balance while its body moves up and down. Many existing approaches focus on keeping the robot’s center of mass at a constant height, because that makes the math easier. However, jumping and jogging are exactly the motions where the center of mass must change vertically.

In this work, we explored how preview control can be used to generate vertical motion trajectories for quadruped robots in a simple and efficient way. Preview control is a method where the controller does not only react to the current state, but also uses information about what should happen in the near future. This idea has been widely used for walking, but usually under the assumption of a fixed center of mass height.

The key idea here is that preview control can still be applied even when the center of mass height changes, as long as the pendulum frequency is kept constant. This allows the robot to smoothly plan motions that include both support phases, where the feet are on the ground, and flight phases, where the robot is airborne. By adjusting the reference signal, the same framework can produce jumping or spot-jogging behavior.

We tested this approach in simulation using a realistic model of our quadruped robot, Kara. The generated motions were smooth and continuous, and the robot remained dynamically balanced during both jumping and jogging. When we compared the results with commonly used sinusoidal and polynomial trajectories, the preview control–based approach produced smaller balance errors and lower ground reaction forces. This means the motion is not only stable, but also gentler on the robot’s body.

Another important aspect of this approach is efficiency. The controller runs very fast and is suitable for real-time use, which is essential for dynamic legged robots. This makes it a practical alternative to more computationally expensive optimization-based methods.

Overall, this work shows that preview control is not limited to simple walking motions. With the right formulation, it can also be used to generate agile vertical movements such as jumping and spot-jogging, while remaining simple, efficient, and reliable. The next step is to validate these results on the real quadruped robot.

*This blog post is based on the paper *“Preview Control-based Jumping and Spot-Jogging Trajectory Generation for Quadruped Robots”

Legged robots often lose their balance when something unexpected happens. This can be an extra load, a sudden push, or small modeling errors that are impossible to avoid in real systems. Even if a control method works well in theory, these uncertainties can easily cause unstable behavior.

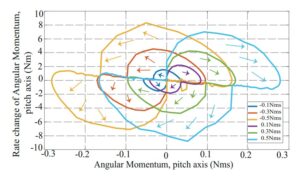

In this work, we focus on making legged robot control more robust by using centroidal momentum. Centroidal momentum describes how the whole robot moves around its center of mass, including both linear and angular motion. Many modern whole-body controllers rely on this concept because it allows coordinated and natural motion. However, centroidal momentum control is highly model-dependent. If the model is not accurate, the controller performance quickly degrades.

To address this problem, we introduce a centroidal momentum observer. The main idea is simple: instead of trusting the model completely, we estimate the effects of unknown disturbances and compensate for them in real time. This is done by integrating a disturbance observer into the centroidal momentum control framework. In this way, the controller can react not only to planned motion, but also to unexpected forces and parameter errors.

We tested this approach in simulation using a one-legged robot model. Several challenging scenarios were considered, such as unknown payloads, external forces, and sudden external momentum disturbances. The results show a clear difference. When the disturbance observer is active, the robot is able to maintain balance and recover smoothly after disturbances. Without it, the robot quickly becomes unstable and falls.

An important outcome of this study is that the proposed method does not significantly increase computational complexity. This makes it suitable for real-time applications, which is essential for legged robots operating in the real world. The controller combines the advantages of centroidal momentum control with the robustness of disturbance observers.

Overall, this work shows that adding disturbance awareness to whole-body control is a powerful way to improve reliability. Instead of designing increasingly complex models, we allow the controller to adapt to uncertainty directly. This approach brings legged robots one step closer to stable and dependable operation in real environments.

*This blog post is based on the paper *“Centroidal Momentum Observer: Towards Whole-Body Robust Control of Legged Robots Subject to Uncertainties”